Durante años hemos hablado de alfabetización en IA como si fuera el objetivo. No lo es. Es el punto de partida. Lo que viene después es más exigente, más útil y, en buena medida, todavía no estamos enseñándolo bien.

Una persona puede conocer ChatGPT, haber hecho cursos de prompts, manejar varias herramientas con soltura y, aun así, trabajar mal con IA.

Puede aceptar la primera respuesta sin cuestionarla. Puede producir más texto y pensar menos. Puede usar la IA para ahorrarse justo el esfuerzo cognitivo que necesitaba para aprender. Puede confundir velocidad con calidad.

El problema no es la herramienta. Es la relación con la herramienta.

Y esa distinción importa mucho en educación, porque define qué enseñamos cuando decimos que «formamos en IA».

La fluidez simbiótica con IA es la capacidad de integrar sistemas de inteligencia artificial en el propio proceso de pensamiento, creación y decisión, manteniendo el criterio, la agencia y la responsabilidad humana sobre el resultado.

El concepto toma su raíz de J.C.R. Licklider, que en 1960 describía la simbiosis hombre-ordenador como un modelo en el que las máquinas asumen el trabajo rutinario para que las personas puedan formular problemas, tomar decisiones y manejar situaciones complejas. Más de sesenta años después, con la IA generativa, esa idea vuelve con una urgencia nueva.

La fluidez simbiótica no es lo mismo que la alfabetización en IA, aunque la necesita como base. Y tampoco es lo mismo que la fluidez en IA, aunque comparte parte del marco. Vale la pena distinguir los tres niveles:

Alfabetización en IA: entender qué es la IA generativa, cómo funciona de forma básica, qué límites tiene, por qué puede inventar respuestas y qué riesgos implica. Es el primer escalón, necesario pero insuficiente.

Fluidez en IA: usar la IA de forma efectiva, segura y con criterio. Saber delegar bien, describir bien la tarea, discernir la calidad de la respuesta y asumir la responsabilidad del resultado. Aquí ya hay más exigencia.

Fluidez simbiótica: la IA deja de ser una herramienta externa y se integra en la forma de pensar, crear, revisar y decidir. El juicio final sigue siendo humano, pero el proceso se ha transformado. La IA ya no está «al lado». Está dentro del flujo.

La diferencia es concreta. Vale la pena verla con un ejemplo del ámbito educativo.

No es lo mismo pedirle a un modelo «hazme una propuesta de formación sobre IA para docentes» que usarlo para contrastar el contexto de un centro, anticipar resistencias, adaptar una actividad a la etapa, revisar riesgos antes de presentar y detectar puntos débiles en el planteamiento.

En el primer caso la IA produce. En el segundo, ayuda a pensar.

La distancia entre esos dos usos no es pequeña. En el primero, el profesional copia o adapta. En el segundo, el profesional decide, contrasta, refina y asume la autoría completa del resultado. El proceso cognitivo implicado es radicalmente distinto.

Esto conecta con algo que la investigación emergente sobre colaboración humano-IA empieza a documentar con claridad: los beneficios en productividad y creatividad son reales, pero también lo son los riesgos de sobreconfianza, pérdida de metacognición y delegación irresponsable cuando no se entrena el criterio. Una herramienta puede mejorar la productividad y al mismo tiempo debilitar determinados procesos cognitivos si se usa sin método.

La fluidez simbiótica se trabaja en dimensiones concretas. No son actitudes vagas ni disposiciones genéricas. Tienen indicadores observables y pueden evaluarse.

Mentalidad colaborativa. Ver la IA como apoyo cognitivo, no como enemiga ni como oráculo. Entender sus posibilidades y sus límites con precisión.

Delegación estratégica. Saber qué tiene sentido delegar y qué no. La IA puede resumir, comparar, generar borradores, detectar incoherencias. No puede sustituir el juicio profesional, la sensibilidad ética ni la responsabilidad sobre decisiones que afectan a personas.

Formulación efectiva del contexto. Aquí está una de las claves reales. No se trata de escribir buenos prompts. Se trata de construir buen contexto: objetivo, destinatario, restricciones, criterios de calidad, ejemplos, tono, fuentes, límites. La IA responde mejor cuando la persona piensa mejor el entorno de trabajo.

Evaluación crítica de la respuesta. La IA puede producir respuestas verosímiles pero incorrectas. Puede sonar rigurosa e inventar fuentes. Puede adaptarse a lo que quieres oír. Trabajar con IA exige una actitud de sospecha razonable: no paranoia, sino criterio profesional activo.

Responsabilidad sobre el resultado. La autoría, la decisión final y la responsabilidad siguen siendo humanas. «La IA me lo ha dado así» no es una excusa aceptable en ningún contexto profesional o educativo.

En el debate educativo sobre IA se habla mucho de plagio, de detectores y de si permitir o prohibir. Se habla menos de algo más profundo: lo que ocurre cuando alguien aprende a depender de la IA sin haber aprendido a trabajar con ella.

Un estudio reciente con trabajadores del conocimiento reveló que el aumento de confianza en la IA se correlaciona con menor esfuerzo crítico propio. Los usuarios con alta confianza en las respuestas generadas mostraron menos pensamiento crítico en sus tareas. Otro trabajo documentó que la mayoría de las personas sobreestiman su rendimiento cuando usan IA, especialmente quienes se consideraban más «alfabetizados».

Dicho de otra forma: la IA puede hacerte más productivo y más superficial al mismo tiempo. Puede ayudarte a aprender y puede ahorrarte el esfuerzo que necesitabas para aprender. Puede ayudarte a escribir mejor y puede borrar tu voz.

La fluidez simbiótica no resuelve eso automáticamente. Pero sí nombra con precisión qué hay que entrenar para que no ocurra.

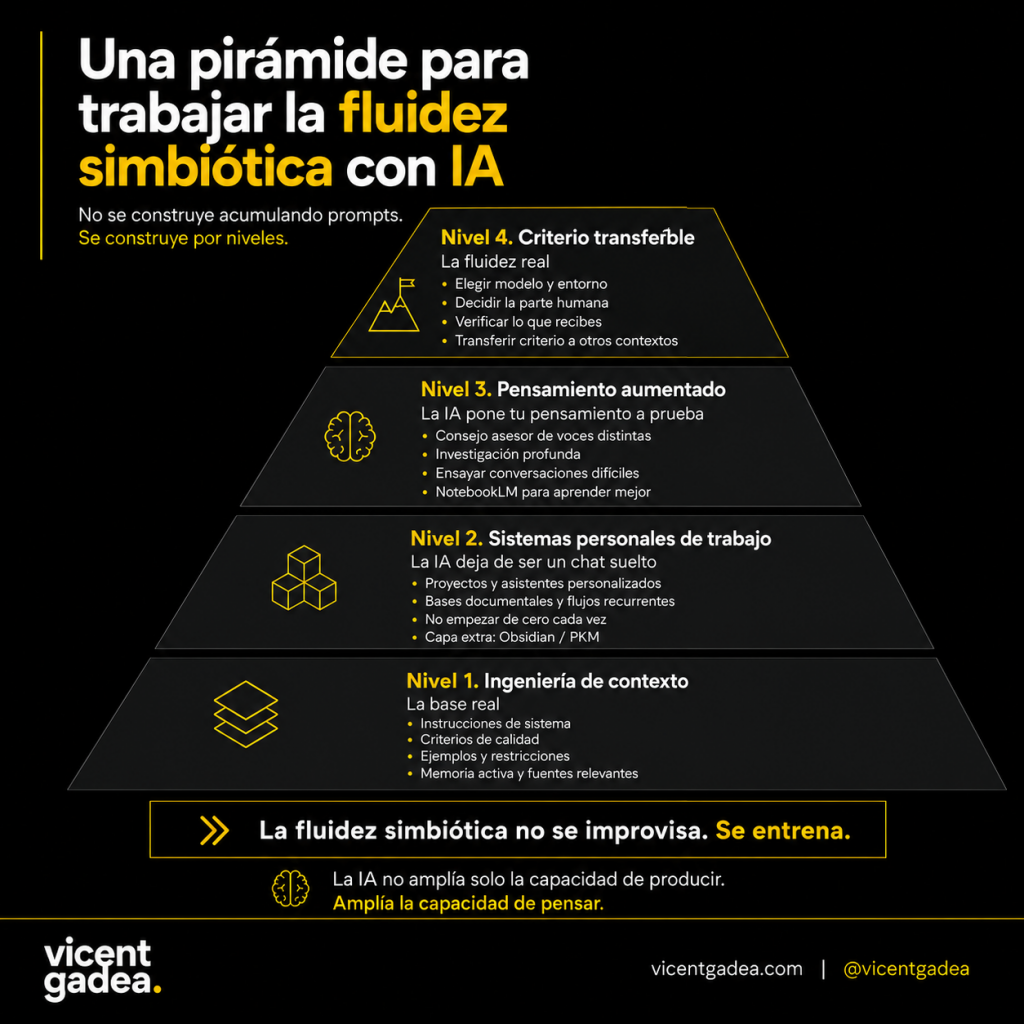

La fluidez simbiótica no se construye aprendiendo una herramienta aislada ni acumulando trucos de prompting. Se construye por niveles. Y la mayoría de personas, incluidas muchas que se consideran usuarias avanzadas, se quedan en los primeros sin saberlo.

No hablo de escribir mejores prompts. Hablo de preparar bien el entorno antes de trabajar: instrucciones de sistema, criterios de calidad explícitos, ejemplos de referencia, restricciones, estilo, memoria activa y fuentes relevantes.

La diferencia entre pedirle algo a una IA genérica y trabajar con una IA que ha interiorizado tu contexto no es una diferencia de grado. Es una diferencia de tipo. Sin este nivel, todo lo que viene después es menos preciso y más lento.

Aquí la IA deja de ser una ventana de chat suelta. Entran los proyectos, los asistentes personalizados, las bases documentales, los flujos recurrentes y las instrucciones específicas por tarea. La idea central es no empezar desde cero cada vez. Cada sistema que construyes es conocimiento acumulado que la IA puede activar cuando lo necesitas.

A esto se puede añadir una capa más relevante: sistemas de conocimiento personal estructurado como Obsidian, que funcionan como memoria externa organizada que la IA puede leer y con la que puede trabajar. No como libreta de notas, sino como repositorio que alimenta tus flujos de manera sistemática. Es una dinámica que merece desarrollo propio, y lo tendrá en próximos artículos.

En este nivel la IA ya no sirve principalmente para producir más rápido. Sirve para someter el propio pensamiento a presión antes de tomar una decisión o presentar algo.

Eso incluye trabajar con un consejo asesor de voces distintas que critican una idea desde ángulos diferentes, hacer investigación profunda antes de escribir o proponer, preparar y entrenar conversaciones difíciles o reuniones de alto riesgo, y detectar los puntos débiles de un planteamiento antes de que lo haga otro.

Aquí también entra un uso de NotebookLM que va mucho más allá del resumen automático. Cuando tienes que aprender un campo que no dominas, la alternativa habitual es invertir decenas de horas en vídeos, artículos dispersos y notas que nunca acabas de conectar. Con un flujo bien construido en NotebookLM puedes condensar en pocas horas lo esencial de veinte fuentes distintas, triangular perspectivas, identificar los conceptos clave y generar dinámicas de aprendizaje activo a partir de ese corpus. No es leer más rápido. Es aprender de otra manera.

Este es el nivel que distingue la fluidez simbiótica real de un uso avanzado pero dependiente.

La persona ya no necesita una herramienta concreta ni un flujo cerrado. Sabe decidir qué modelo o entorno le conviene para cada tarea, qué parte del proceso debe seguir haciendo ella, cómo verificar lo que recibe y, sobre todo, cómo trasladar ese criterio a contextos distintos: una clase, una reunión, una investigación, una decisión de centro, una propuesta profesional.

Aquí la IA deja de ser una herramienta que se abre para resolver algo puntual. Pasa a funcionar como una capa de trabajo: algo que atraviesa cómo piensas antes de actuar, cómo produces, cómo revisas y cómo aprendes. No está en un sitio concreto del flujo. Está en todos.

Quien usa la IA como herramienta depende de recordar cuándo abrirla. Quien la tiene integrada como capa ya no hace esa pregunta: el criterio sobre cuándo y cómo usarla forma parte de su manera de trabajar.

En este nivel la IA no amplía solo la capacidad de producir. Amplía la capacidad de pensar.

La fluidez simbiótica no es solo una competencia individual. También puede ser, y debería ser, una competencia institucional.

Un centro puede tener criterios compartidos sobre qué tareas pueden hacerse con IA, cuáles conviene preservar sin ella, qué usos deben declararse, qué evidencias de aprendizaje se van a pedir y qué datos no deberían introducirse nunca en herramientas externas. O puede dejar que cada docente lo resuelva como pueda, y cada alumno lo aprenda por su cuenta fuera del aula.

La diferencia entre esos dos escenarios no es técnica. Es de gobernanza, de criterio pedagógico y de liderazgo institucional.

Esto tiene consecuencias directas para la evaluación. Si el alumnado usa IA, ya no basta con preguntar si la ha usado o no. Hay que mirar cómo la ha usado. Marcos como SEIA pueden ayudar a estructurar esa conversación: no para convertir la evaluación en un sistema rígido, sino para distinguir niveles de uso, grados de autonomía del alumnado y evidencias relevantes. Una tarea sin IA, una con apoyo puntual y una en la que la herramienta asume una parte central del trabajo no son la misma cosa pedagógicamente.

El Evidence Hub que lancé va en esa dirección: ayudar a pensar qué evidencias pedir cuando la IA ya está presente. Justificaciones breves, defensa oral, registros de proceso, comparación de versiones, transferencia, revisión crítica. La idea no es pedir más, sino pedir mejor: aquello que permite ver si ha habido aprendizaje real detrás del producto.

Hay una brecha que empieza a abrirse. No solo entre quienes tienen acceso a IA y quienes no. También entre quienes saben trabajar con ella y quienes la usan de forma pobre.

La IA puede hacer más visible la diferencia entre quien tiene criterio y quien no. Entre quien sabe construir contexto y quien espera que la herramienta lo haga todo. Entre quien usa la IA para ampliar su pensamiento y quien la usa para evitar pensar.

Eso no debería dejarnos indiferentes en educación.

Porque si no enseñamos fluidez simbiótica de forma deliberada, no estamos preparando al alumnado para trabajar con sistemas inteligentes. Los estamos dejando solos con ellos.

Si estás en un centro educativo, una universidad o una institución formativa y estás trabajando para estructurar mejor el uso de la IA, puedo acompañar ese proceso. Puedes contactarme en vicentgadea@outlook.com.

También puedes suscribirte a GadeIA, mi newsletter semanal sobre IA en educación con criterio, donde desarrollo estas ideas con más profundidad cada semana.

Referencias y marcos de referencia utilizados en este artículo: