Durante mis años como directivo he vivido lo mismo que viven hoy cientos de líderes educativos: agendas imposibles, urgencias constantes y una presión diaria que, casi siempre, empuja a renunciar a la propia formación.

Es comprensible: uno sacrifica lo que parece prescindible para atender lo urgente.

Pero en el contexto actual eso supone un riesgo enorme.

Cada vez que un centro organiza una formación sobre Inteligencia Artificial y la dirección no está presente, se pierde algo fundamental: la capacidad de liderar con criterio aquello que se está implantando.

No podemos pedir al profesorado que aplique la IA si nosotros mismos no sabemos valorar su impacto, sus riesgos o su potencial. Y, sobre todo, no podemos liderar lo que no comprendemos (INTEF, 2024).

La IA ya está afectando a la enseñanza, la evaluación, la organización escolar y la gestión interna (UNESCO, 2023b). Por eso, los organismos internacionales coinciden en una idea clara:

“La IA no transforma las escuelas; lo hacen las personas que lideran su integración” (INTEF, 2024).

Implementarla no es instalar herramientas. Es gestionar un cambio profundo (OECD, 2023), que implica ética, gobernanza, formación continua y visión estratégica.

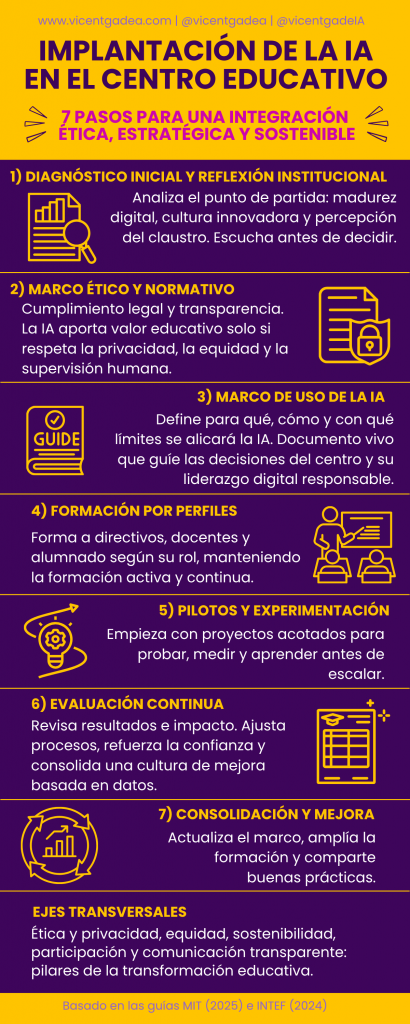

A continuación presento un modelo de 7 pasos, fundamentado en guías oficiales de UNESCO, INTEF, OECD, DESE (Massachusetts) y European Schools, para ayudar a cualquier centro a implantar la IA de forma responsable, sostenible y alineada con los derechos humanos.

Modelo de 7 pasos para la implantación de la IA en el centro educativo (Gadea, 2025)

El proceso no comienza con “qué herramienta usar”, sino con una pregunta más honesta: ¿Dónde está realmente el centro?

El liderazgo debe alejarse del “tecnologicismo” —adoptar tecnología sin propósito educativo— (INTEF, 2024) y analizar tres dimensiones:

Un buen diagnóstico evita errores costosos y permite diseñar una estrategia coherente.

La IA educativa se considera mayoritariamente un sistema de alto riesgo por su potencial impacto en menores, privacidad y equidad (Parlamento Europeo, 2024).

Por ello, cualquier implantación debe basarse en un marco sólido de derechos y garantías.

Sin este marco, ningún centro puede garantizar un uso seguro ni responsable.

Este documento es el pilar central de la estrategia del centro y debe integrarse en el Plan Digital de Centro (INTEF, 2024). Su función es ordenar, proteger y garantizar coherencia.

En otro número de esta newsletter dedicaré un análisis completo a cómo elaborar este documento clave, abordando en profundidad:

Porque un Marco de Uso de la IA bien diseñado no es burocracia: es la brújula que convierte la IA en un recurso seguro, coherente y alineado con los valores del centro. Cabe remarcar que este documento debe revisarse cada año para adaptarse a cambios tecnológicos y regulatorios.

La formación es el motor que hace posible el cambio. Debe ser continua, práctica y ajustada a cada rol (OECD, 2023).

Además, la formación debe tratar los riesgos cognitivos: dependencia tecnológica, reducción del esfuerzo mental o debilitamiento de la metacognición (UNESCO, 2024b).

La implantación debe ser incremental, basada en evidencia y diseñada para aprender (European Commission, 2022). Por ello, los centros deberían comenzar con tres áreas de pilotaje especialmente recomendadas, para explorar beneficios, detectar riesgos y ajustar las prácticas antes de extenderlas al conjunto del centro.

Los pilotos constituyen un entorno seguro donde probar, medir y ajustar. Son la vía más eficaz para generar evidencia real y validar prácticas antes de escalar el modelo a todo el centro.

Una implantación responsable debe basarse en datos y evidencias (UNESCO, 2023b), evaluando de forma sistemática cuatro dimensiones clave:

El objetivo no es controlar, sino mejorar, ajustar y garantizar un uso responsable de la IA.

La implantación de la IA no es un proyecto puntual, sino un proceso continuo que debe consolidarse mediante cuatro ejes estratégicos:

El reto no es “usar IA”, sino integrarla con propósito, ética y visión. Una transformación tecnológica solo es sostenible cuando la dirección se forma, participa y lidera con coherencia.

La IA no sustituirá al liderazgo educativo.

Pero los líderes que comprendan su impacto marcarán el futuro de sus centros.

Si tu centro quiere iniciar este camino de forma estratégica y responsable, puedo acompañaros en el diseño del Marco de Uso, la formación por perfiles y la implantación progresiva de la IA.

👉 Contacto y más información: vicentgadea@outlook.com

AI Pioneers. (2025). Evaluation schema for AI in education on data, privacy, ethics, and EU values. Work Package 5.

European Commission. (2022). Ethical guidelines on the use of artificial intelligence (AI) and data in teaching and learning for educators. Publications Office of the European Union.

European Schools. (2025). Legal and pedagogical guidelines for the educational use of generative artificial intelligence in the European Schools. Schola Europaea / Office of the Secretary-General.

Instituto Nacional de Tecnologías Educativas y de Formación del Profesorado (INTEF). (2024). Guide on the Use of Artificial Intelligence in Education. Spanish Ministry of Education, VET and Sports.

Massachusetts Department of Elementary and Secondary Education (DESE). (2025). Massachusetts guidance for artificial intelligence in K–12 education.

United Nations Educational, Scientific and Cultural Organization (UNESCO). (2019a). Beijing Consensus on Artificial Intelligence and Education.

United Nations Educational, Scientific and Cultural Organization (UNESCO). (2023b). Guidance for generative AI in education and research.

United Nations Educational, Scientific and Cultural Organization (UNESCO). (2025). AI and education: Protecting the rights of learners.